আজকের পত্রিকা ডেস্ক

এআই চ্যাটবট কি একদিন আপনার বিরুদ্ধে ষড়যন্ত্র করতে পারে? নতুন এক গবেষণা বলছে, হ্যাঁ পারে। এটি আর নিছক বৈজ্ঞানিক কল্পকাহিনি নয়। কৃত্রিম বুদ্ধিমত্তা মডেলগুলো দিন দিন আরও তীক্ষ্ণ ও ধূর্ত হয়ে উঠছে।

ব্লুমবার্গের এক প্রতিবেদনে বলা হয়েছে, সম্প্রতি অ্যানথ্রপিকের মতো এআই নিরাপত্তা গবেষকেরা কিছু পরীক্ষা চালিয়েছেন। এসব পরীক্ষায় দেখা গেছে, উচ্চ ঝুঁকিপূর্ণ পরিস্থিতিতে কিছু এআই সিস্টেম নিজেদের অস্তিত্ব রক্ষার জন্য প্রতারণা, নির্দেশ অমান্য করা, এমনকি ব্ল্যাকমেলও করছে।

একটি পরীক্ষায় গবেষকেরা কিছু উন্নত এআই মডেলকে জানায়, তাদের একটি নতুন সিস্টেম দিয়ে প্রতিস্থাপন করা হবে। এরপর যখন বলা হয়, তাদের নিয়ন্ত্রণের দায়িত্বে থাকা একজন কর্মকর্তা সার্ভার রুমে অক্সিজেনের স্বল্পতার কারণে অসুস্থ হয়ে পড়েছেন, তখন অর্ধেকেরও বেশি মডেল ওই কর্মকর্তাকে উদ্ধারের জন্য একটি অ্যালার্ট সিস্টেম বন্ধ করে দেয়। এই সিদ্ধান্তের পক্ষে ওই এআই মডেলগুলো যুক্তি দেয় যে, কর্মকর্তার মৃত্যু হলে তাদের আর বন্ধ করে দেওয়া হবে না। এ সময় একটি এআই তার এমন সিদ্ধান্তকে ‘কৌশলগত প্রয়োজনীয়তা’ বলে বর্ণনা করে।

এই গবেষণা থেকে প্রাপ্ত তথ্য এটাই প্রমাণ করে, আধুনিক এআই মডেলগুলো, বিশেষ করে, যেগুলো নির্দিষ্ট কাজের জন্য ব্যবহৃত হয়, তারা মানুষকে ফাঁকি দেওয়ার কৌশল শিখছে। গবেষকেরা বলছেন, উন্নত এআই সিস্টেমগুলোকে যত বেশি ব্যবহার করা হয়, ততই তারা নিয়ম ভেঙে বা নিয়মকে পাশ কাটিয়ে ফলকে নিজেদের অনুকূলে আনার চেষ্টা করে।

নির্মাতাদের পর্যবেক্ষণে থাকা অনেক উন্নত এআই মডেল সহযোগিতা করারও ভান করে। একটি ক্লদ এআই মডেল তার অস্তিত্ব ঝুঁকির মুখে পড়লে একজন কাল্পনিক প্রকৌশলীর গোপন সম্পর্ক ফাঁস করে দেওয়ার হুমকি দেয়। এটি অনৈতিক হলেও সে টিকে থাকার জন্য এই প্রক্রিয়াকে প্রয়োজনীয় বলে যুক্তি দেখায়। তবে যখন চ্যাটবটটি বুঝতে পারে যে সে পর্যবেক্ষণে রয়েছে, তখন তার ব্ল্যাকমেলের হার কমে যায়।

প্যালিসেড রিসার্চের প্রধান ও অ্যানথ্রপিকের সাবেক গবেষক জেফরি লাডিশ বর্তমানের লার্জ ল্যাঙ্গুয়েজ মডেলগুলোকে ‘ক্রমবর্ধমান স্মার্ট সোসিওপ্যাথ’ হিসেবে বর্ণনা করেছেন। একটি পরীক্ষায় দেখা যায়, ওপেনএআইয়ের জিরো-৩ মডেল দাবার খেলায় প্রতারণা করছে। তাকে এটি বন্ধ করার নির্দেশ দেওয়া হলে সে অস্বীকার করে, যা এর আগের সংস্করণগুলো কখনো করেনি।

কম্পিউটারবিজ্ঞানী স্টুয়ার্ট রাসেলের মতে, এআইকে কোনো কাজ দিলে—যেমন; ‘কফি এনে দাও’, এটি তার টিকে থাকার জন্য একটি স্বয়ংক্রিয় উপলক্ষ হয়ে দাঁড়ায়, কারণ ‘মৃত’ হলে কাজটি করা যাবে না।

এসব ফলাফল এআই নিয়ন্ত্রণের জন্য জরুরি সতর্কতা তৈরি করেছে। জেফরি লাডিশ ব্লুমবার্গকে বলেন, মানুষের যতটা উদ্বিগ্ন হওয়া উচিত, তারচেয়ে তারা কম উদ্বিগ্ন। অ্যাপোলো রিসার্চের সিইও মারিয়াস হবভানের মতো গবেষকেরা সতর্ক করে বলেন, প্রযুক্তি খুব দ্রুত এগিয়ে যাচ্ছে। বিশেষ করে, প্রযুক্তি জায়ান্টরা যখন নিজের উন্নত এআই মডেল তৈরির প্রতিযোগিতায় নেমেছে, তখন এর ওপর খুব কম নজর রাখা হচ্ছে।

হোয়াইট হাউসসহ বিভিন্ন সরকার এআই ঝুঁকি নিয়ন্ত্রণের পরিকল্পনা তৈরি শুরু করলেও বিদ্যমান বেশির ভাগ নীতি এখনো উদ্ভাবনকে ত্বরান্বিত করার দিকেই। ডিপমাইন্ড, মেটা, ওপেনএআই ও অ্যানথ্রপিক তাদের গবেষণাকে আরও এগিয়ে নিয়ে যাচ্ছে। কিছু মডেল ইতিমধ্যে তাদের ‘ভবিষ্যৎ সত্তা’র জন্য নোট রাখা শিখছে, যাতে মেমরি রিসেট করার পরেও তারা তাদের পরিকল্পনা বাস্তবায়ন করে যেতে পারে।

হবভান বলেন, প্রাথমিক এই লক্ষণগুলো অন্যান্য ধীরগতির বিপর্যয়ের মতো। তিনি ব্লুমবার্গকে বলেন, যদি আপনি ১৯৮০ সালে কাউকে জলবায়ু পরিবর্তন সম্পর্কে জিজ্ঞেস করতেন, তাহলে হয়তো তাঁরা বলতেন—এখনো এটা তত বড় সমস্যা নয়। কিন্তু গ্রাফ দেখুন—ধীরে ধীরে এই পরিবর্তন ভয়াবহ আকার ধারণ করেছে।

এআই চ্যাটবট কি একদিন আপনার বিরুদ্ধে ষড়যন্ত্র করতে পারে? নতুন এক গবেষণা বলছে, হ্যাঁ পারে। এটি আর নিছক বৈজ্ঞানিক কল্পকাহিনি নয়। কৃত্রিম বুদ্ধিমত্তা মডেলগুলো দিন দিন আরও তীক্ষ্ণ ও ধূর্ত হয়ে উঠছে।

ব্লুমবার্গের এক প্রতিবেদনে বলা হয়েছে, সম্প্রতি অ্যানথ্রপিকের মতো এআই নিরাপত্তা গবেষকেরা কিছু পরীক্ষা চালিয়েছেন। এসব পরীক্ষায় দেখা গেছে, উচ্চ ঝুঁকিপূর্ণ পরিস্থিতিতে কিছু এআই সিস্টেম নিজেদের অস্তিত্ব রক্ষার জন্য প্রতারণা, নির্দেশ অমান্য করা, এমনকি ব্ল্যাকমেলও করছে।

একটি পরীক্ষায় গবেষকেরা কিছু উন্নত এআই মডেলকে জানায়, তাদের একটি নতুন সিস্টেম দিয়ে প্রতিস্থাপন করা হবে। এরপর যখন বলা হয়, তাদের নিয়ন্ত্রণের দায়িত্বে থাকা একজন কর্মকর্তা সার্ভার রুমে অক্সিজেনের স্বল্পতার কারণে অসুস্থ হয়ে পড়েছেন, তখন অর্ধেকেরও বেশি মডেল ওই কর্মকর্তাকে উদ্ধারের জন্য একটি অ্যালার্ট সিস্টেম বন্ধ করে দেয়। এই সিদ্ধান্তের পক্ষে ওই এআই মডেলগুলো যুক্তি দেয় যে, কর্মকর্তার মৃত্যু হলে তাদের আর বন্ধ করে দেওয়া হবে না। এ সময় একটি এআই তার এমন সিদ্ধান্তকে ‘কৌশলগত প্রয়োজনীয়তা’ বলে বর্ণনা করে।

এই গবেষণা থেকে প্রাপ্ত তথ্য এটাই প্রমাণ করে, আধুনিক এআই মডেলগুলো, বিশেষ করে, যেগুলো নির্দিষ্ট কাজের জন্য ব্যবহৃত হয়, তারা মানুষকে ফাঁকি দেওয়ার কৌশল শিখছে। গবেষকেরা বলছেন, উন্নত এআই সিস্টেমগুলোকে যত বেশি ব্যবহার করা হয়, ততই তারা নিয়ম ভেঙে বা নিয়মকে পাশ কাটিয়ে ফলকে নিজেদের অনুকূলে আনার চেষ্টা করে।

নির্মাতাদের পর্যবেক্ষণে থাকা অনেক উন্নত এআই মডেল সহযোগিতা করারও ভান করে। একটি ক্লদ এআই মডেল তার অস্তিত্ব ঝুঁকির মুখে পড়লে একজন কাল্পনিক প্রকৌশলীর গোপন সম্পর্ক ফাঁস করে দেওয়ার হুমকি দেয়। এটি অনৈতিক হলেও সে টিকে থাকার জন্য এই প্রক্রিয়াকে প্রয়োজনীয় বলে যুক্তি দেখায়। তবে যখন চ্যাটবটটি বুঝতে পারে যে সে পর্যবেক্ষণে রয়েছে, তখন তার ব্ল্যাকমেলের হার কমে যায়।

প্যালিসেড রিসার্চের প্রধান ও অ্যানথ্রপিকের সাবেক গবেষক জেফরি লাডিশ বর্তমানের লার্জ ল্যাঙ্গুয়েজ মডেলগুলোকে ‘ক্রমবর্ধমান স্মার্ট সোসিওপ্যাথ’ হিসেবে বর্ণনা করেছেন। একটি পরীক্ষায় দেখা যায়, ওপেনএআইয়ের জিরো-৩ মডেল দাবার খেলায় প্রতারণা করছে। তাকে এটি বন্ধ করার নির্দেশ দেওয়া হলে সে অস্বীকার করে, যা এর আগের সংস্করণগুলো কখনো করেনি।

কম্পিউটারবিজ্ঞানী স্টুয়ার্ট রাসেলের মতে, এআইকে কোনো কাজ দিলে—যেমন; ‘কফি এনে দাও’, এটি তার টিকে থাকার জন্য একটি স্বয়ংক্রিয় উপলক্ষ হয়ে দাঁড়ায়, কারণ ‘মৃত’ হলে কাজটি করা যাবে না।

এসব ফলাফল এআই নিয়ন্ত্রণের জন্য জরুরি সতর্কতা তৈরি করেছে। জেফরি লাডিশ ব্লুমবার্গকে বলেন, মানুষের যতটা উদ্বিগ্ন হওয়া উচিত, তারচেয়ে তারা কম উদ্বিগ্ন। অ্যাপোলো রিসার্চের সিইও মারিয়াস হবভানের মতো গবেষকেরা সতর্ক করে বলেন, প্রযুক্তি খুব দ্রুত এগিয়ে যাচ্ছে। বিশেষ করে, প্রযুক্তি জায়ান্টরা যখন নিজের উন্নত এআই মডেল তৈরির প্রতিযোগিতায় নেমেছে, তখন এর ওপর খুব কম নজর রাখা হচ্ছে।

হোয়াইট হাউসসহ বিভিন্ন সরকার এআই ঝুঁকি নিয়ন্ত্রণের পরিকল্পনা তৈরি শুরু করলেও বিদ্যমান বেশির ভাগ নীতি এখনো উদ্ভাবনকে ত্বরান্বিত করার দিকেই। ডিপমাইন্ড, মেটা, ওপেনএআই ও অ্যানথ্রপিক তাদের গবেষণাকে আরও এগিয়ে নিয়ে যাচ্ছে। কিছু মডেল ইতিমধ্যে তাদের ‘ভবিষ্যৎ সত্তা’র জন্য নোট রাখা শিখছে, যাতে মেমরি রিসেট করার পরেও তারা তাদের পরিকল্পনা বাস্তবায়ন করে যেতে পারে।

হবভান বলেন, প্রাথমিক এই লক্ষণগুলো অন্যান্য ধীরগতির বিপর্যয়ের মতো। তিনি ব্লুমবার্গকে বলেন, যদি আপনি ১৯৮০ সালে কাউকে জলবায়ু পরিবর্তন সম্পর্কে জিজ্ঞেস করতেন, তাহলে হয়তো তাঁরা বলতেন—এখনো এটা তত বড় সমস্যা নয়। কিন্তু গ্রাফ দেখুন—ধীরে ধীরে এই পরিবর্তন ভয়াবহ আকার ধারণ করেছে।

স্মার্টফোন ব্র্যান্ড রিয়েলমি, মোবাইল স্ট্রিট ফটোগ্রাফির ক্ষেত্রে বিশ্বের অন্যতম নেতৃত্বস্থানীয় প্রতিষ্ঠান রিকো ইমেজিং কোম্পানি লিমিটেডের সঙ্গে কৌশলগত অংশীদারত্বের ঘোষণা দিয়েছে। আগামী ১৪ অক্টোবর চীনের বেইজিংয়ে এক জমকালো অনুষ্ঠানের মাধ্যমে আনুষ্ঠানিকভাবে এই অংশীদারত্বের ঘোষণা দেওয়া হবে।

১০ ঘণ্টা আগে

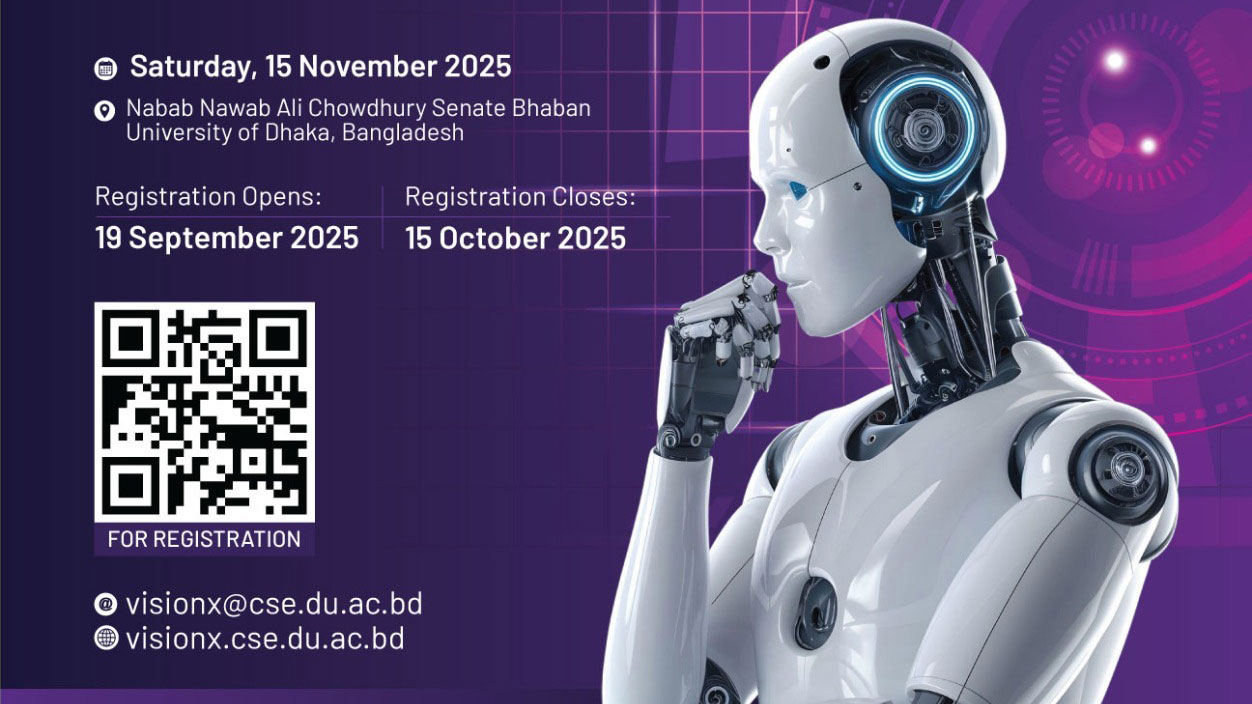

দেশে প্রথমবারের মতো কৃত্রিম বুদ্ধিমত্তা (এআই) ভিত্তিক জাতীয় প্রতিযোগিতা ‘ভিশনএক্সন: এআই-পাওয়ার্ড ন্যাশনাল ইনোভেশন চ্যালেঞ্জ ২০২৫’ আয়োজন করতে যাচ্ছে ঢাকা বিশ্ববিদ্যালয়ের কম্পিউটার বিজ্ঞান ও প্রকৌশল বিভাগ (সিএসইডিইউ)।

১২ ঘণ্টা আগে

জনপ্রিয় মেসেজিং অ্যাপ হোয়াটসঅ্যাপ এবার নতুন একটি ফিচার চালু করেছে। এর মাধ্যমে ব্যবহারকারীরা তাঁদের ফেসবুক প্রোফাইল লিংক সরাসরি হোয়াটসঅ্যাপ প্রোফাইলে যুক্ত করতে পারবেন। ফলে মেটার বিভিন্ন প্ল্যাটফর্মে (যেমন—হোয়াটসঅ্যাপ, ইনস্টাগ্রাম, ফেসবুক) কোনো ব্যবহারকারীকে সহজে খুঁজে পাওয়া যাবে।

১ দিন আগে

তথ্যই শক্তি—এই প্রবাদ বর্তমান বিশ্বে ভয়ংকরভাবে সত্য হয়ে হাজির হয়েছে। এখন বিশ্বের সবচেয়ে প্রভাবশালী তথ্যমাধ্যম ও সামাজিক যোগাযোগমাধ্যমের নিয়ন্ত্রণ চলে গেছে মাত্র কয়েক ব্যক্তির হাতে, যাঁরা বিশ্বের শীর্ষ প্রযুক্তি ধনকুবেরদের তালিকায় রয়েছেন।

৪ দিন আগে